India plantó su bandera en la arena de la inteligencia artificial global carrera el martes como una agencia importante dicho el gobierno no tiene planes para regular la tecnología.

La audaz proclamación llega solo una semana después de más de 500 Expertos en IA firmaron una carta abierta instando a los laboratorios de IA a pausar el desarrollo de nuevos Modelos de lenguaje grande estilo GPT4 en medio de una mayor seguridad de la tecnología por parte de los legisladores en los EE. UU. y Europa.

en un declaración el martes, el Ministerio de Electrónica y Tecnología de la Información de la India reconoció numerosas preocupaciones éticas en torno al sesgo y la transparencia que podría surgir con la rápida expansión de la IA, pero dijo explícitamente que el gobierno indio “no está considerando promulgar una ley o regular el crecimiento de la inteligencia artificial en el país”. En cambio, el ministerio se refirió a la IA como un “facilitador cinético de la economía digital”, que cree que fortalecerá el espíritu empresarial y los negocios y desempeñará un papel estratégico importante para que el país avance.

El ministerio dijo que funcionarios eran trabajando para estandarizar las pautas de IA responsable para dirigir el desarrollo de la IA y promover un crecimiento saludable en la industria, pero notablemente rehuyó expresar el mismo nivel de alarma planteado por un número creciente de políticos en los EE.UU. y Europa.

G/O Media puede recibir una comisión

Los temores de la IA alcanzan nuevas alturas

El explosión repentina de herramientas de IA generativa en la corriente principal gracias a ChatGPT de OpenAI y Bardo de Google modelos ha llevado a voces poderosas a pedir a los fabricantes de IA que pisen el freno. La semana pasada, cientos de expertos en inteligencia artificial, incluidos Elon Musk y el cofundador de Apple, Steve Wozniak, firmaron un carta abierta pidiendo a los laboratorios de IA que detener el desarrollo de nuevos y poderosos lenguajes grandesmodelos de edad. La carta dice que los sistemas como GPT4 podrían presentar “riesgos profundos para la sociedad y la humanidad”, si se les permite avanzar sin la protección suficiente. Si las empresas se niegan a aceptar una pausa voluntaria, los firmantes de la carta instaron a los legisladores a avanzar con una moratoria forzosa.

“Seamos claros: el riesgo al que se refieren aquí es la pérdida del control humano sobre el mundo y nuestro propio futuro, al igual que los gorilas han perdido el control sobre su propio futuro a causa de los humanos”, profesor de informática en la Universidad de Berkeley y carta el signatario Stuart Russell le dijo a Gizmodo en una entrevista.

Los mejores investigadores de IA, sin embargo, están divididos en la escala de la amenaza de la IA. Muchos de los firmantes de la carta abierta están realmente preocupados de que los sistemas de inteligencia artificial puedan ser más astutos que los humanos y representar un riesgo existencial fundamental en parte con las armas nucleares y el cambio climático. Otros expertos están de acuerdo en que la postura de la IA podría empeorar la desinformación y el sesgo, pero se burlaron de la idea de atribuir inteligencia a nivel humano a lo que son esencialmente chatbots glorificados. De cualquier manera, ambos campos generalmente están de acuerdo en que se necesitan desesperadamente regulaciones más estrictas.

El presidente Joe Biden incluso intervino en el tema esta semana en observaciones donde los posibles beneficios y peligros asociados con la tecnología. Biden dijo que la IA podría ayudar a abordar problemas difíciles como el cambio climático y el descubrimiento de enfermedades, pero advirtió que también presenta “riesgos potenciales para nuestra sociedad, nuestra economía y nuestra seguridad nacional”. El presidente continuó diciendo que las empresas de tecnología tienen la “responsabilidad” de garantizar que sus sistemas de inteligencia artificial sean seguros antes de lanzarlos al público. Cuando se le preguntó si creía que la IA era peligrosa, Biden respondió: “Queda por verse. Podría ser.”

Olvídese de “¿Qué pasa con China?” ¿Qué pasa con la India podría ser el próximo.

Durante años, tecnólogos, amable los legisladores y otros defensores de la IA han tratado de convencer a los legisladores de que opten por un toque ligero al abordar la regulación de la IA. Cuando se enfrentan a preocupaciones sobre el potencial de la IA para difundir información errónea o amplificar sesgos profundamente arraigados, muchos recurren a un argumento simple pero duradero. Si Estados Unidos no avanza, China lo hará. Los defensores de esta “Wsombrero sobre China?argumento, que incluye notablemente al ex CEO de Google eric schmidtargumentan que Estados Unidos está involucrado en una carrera armamentista de IA con China, lo quiera o no.

Schmidt, quien codirigió la Comisión de Seguridad Nacional sobre IA durante la administración Trump, cree que Estados Unidos debe hacer “lo que sea necesario”, para ganar contra China. El fracaso, según Schmidt, podría resultar en la pérdida de ingresos por valor de billones de dólares dirigidos al rival de EE. UU. y el reajuste de la geopolítica donde China podría usar su dominio de IA para poner a los aliados de EE. UU. en su órbita. Otros defensores del argumento son menos sutiles.

“Si el lado democrático no está a la cabeza en la tecnología, y los autoritarios se adelantan, ponemos en riesgo la totalidad de la democracia y los derechos humanos”, dijo la exembajadora de Estados Unidos ante el Consejo de Derechos Humanos de la ONU, Eileen Donahoe, en una declaración reciente. entrevista con NBC News.

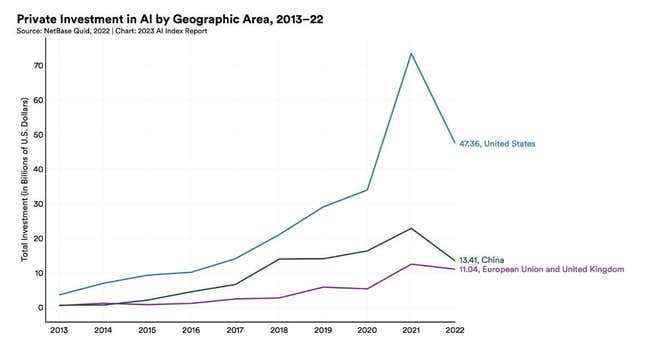

Esos mismos temores generalmente no se extienden a la India, a pesar de que la reciente declaración del país en realidad parece hacerlos más comprometidos con un enfoque de IA de no intervención que China. En los últimos años, los principales reguladores de China han tomado medidas enérgicas contra algunas de sus empresas tecnológicas más grandes y sus fundadores multimillonarios e incluso se trasladaron a aprobar las protecciones de privacidad de datos al estilo del RGPD europeo. Ese entorno regulatorio cada vez más cauteloso ha llevado a una desaceleración relativa en el avance de la IA en China en comparación con los EE. UU. El año pasado, de acuerdo a En el Índice de IA publicado recientemente por Stanford, las empresas estadounidenses invirtieron 47.400 millones de dólares en proyectos de IA. Eso es 3,5 veces más que China. El gráfico a continuación muestra de manera similar un lapso en la inversión china en IA en 2021 justo cuando la inversión estadounidense se disparó.

La nueva actitud total de la India hacia la IA puede deberse acertadamente al hecho de que es notablemente tarde para la fiesta. En términos de inversión general en IA, India gastó solo $ 3.24 en IA el año pasado, lo que los convierte en el quinto país que más gasta en el escenario mundial. Esa cifra es solo una fracción de la cantidad gastada por EE. UU. y China. Y eso nos muestra. Hasta ahora, India no ha logrado generar ni cerca del mismo nivel de nuevas empresas o laboratorios de IA que llamen la atención que sus contrapartes. El nuevo enfoque explícitamente pro-IA podría ayudar a cambiar eso, especialmente si los nuevos tecnólogos ambiciosos se sienten obstaculizados por un entorno regulatorio potencialmente cauteloso en los EE. UU. y otros países.

¿Quiere saber más sobre la IA, los chatbots y el futuro del aprendizaje automático? Consulte nuestra cobertura completa de inteligencia artificialo explore nuestras guías para Los mejores generadores de arte de IA gratuitos y Todo lo que sabemos sobre ChatGPT de OpenAI.