Es importante porque los departamentos de policía están muy por delante y comenzando a usar drones de todos modos, para todo, desde vigilancia y recopilación de inteligencia hasta persiguiendo criminales.

La semana pasada, San Francisco aprobado

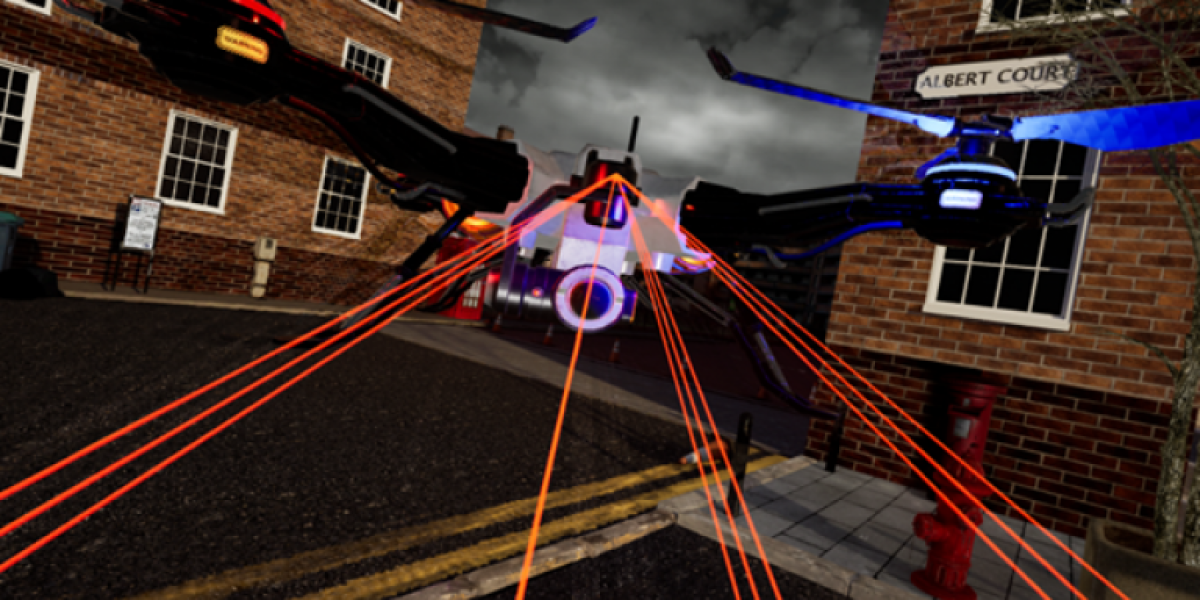

La realidad virtual permitirá que el los investigadores prueban la tecnología

Aunque sabía que estaba en un entorno de realidad virtual, Encontré el encuentro con el dron desconcertante. Mi opinión sobre estos drones no mejoró, a pesar de que conocí a uno operado por humanos supuestamente cortés (hay modos aún más agresivos para el experimento, que no experimenté).

En última instancia, puede que no haga mucha diferencia si los drones son “corteses” o “groseros”, dice Christian Enemark, profesor de la Universidad de Southampton, que se especializa en la ética de la guerra y los drones y no participa en la investigación. Eso se debe a que el uso de drones en sí mismo es un “recordatorio de que la policía no está aquí, ya sea que no se molesten en estar aquí o que tengan demasiado miedo de estar aquí”, dice.

“Así que tal vez haya algo fundamentalmente irrespetuoso en cualquier encuentro”.

Aprendizaje más profundo

Se acerca GPT-4, pero OpenAI todavía está arreglando GPT-3

Internet está lleno de entusiasmo por la última iteración del laboratorio de IA OpenAI de su famoso modelo de lenguaje grande, GPT-3. La última demostración, ChatGPT, responde las preguntas de las personas a través de un diálogo de ida y vuelta. Desde su lanzamiento el pasado miércoles, la demo ha cruzado más de 1 millón de usuarios. Lea la historia de Will Douglas Heaven aquí.

GPT-3 es un mentiroso confiado y se le puede pedir fácilmente que diga cosas tóxicas. OpenAI dice que ha solucionado muchos de estos problemas con ChatGPT, que responde preguntas de seguimiento, admite sus errores, desafía premisas incorrectas y rechaza solicitudes inapropiadas. Incluso se niega a responder algunas preguntas, como cómo ser malvado o cómo entrar en la casa de alguien.