Benj Edwards / Ars Technica

La semana pasada, el ingeniero de software suizo Matthias Bühlmann descubierto que el popular modelo de síntesis de imágenes Stable Diffusion podría comprimir imágenes de mapa de bits existentes con menos artefactos visuales que JPEG o WebP con altas proporciones de compresión, aunque existen advertencias importantes.

Stable Diffusion es un modelo de síntesis de imágenes de IA que normalmente genera imágenes basadas en descripciones de texto (llamadas “indicaciones”). El modelo de IA aprendió esta habilidad al estudiar millones de imágenes extraídas de Internet. Durante el proceso de entrenamiento, el modelo realiza asociaciones estadísticas entre imágenes y palabras relacionadas, creando una representación mucho más pequeña de la información clave sobre cada imagen y almacenándola como “pesos”, que son valores matemáticos que representan lo que sabe el modelo de imagen de IA, por así decirlo. hablar.

Cuando Stable Diffusion analiza y “comprime” imágenes en forma de peso, residen en lo que los investigadores llaman “espacio latente”, que es una forma de decir que existen como una especie de potencial borroso que se puede convertir en imágenes una vez que se decodifican. . Con Stable Diffusion 1.4, el archivo de pesos es de aproximadamente 4 GB, pero representa el conocimiento de cientos de millones de imágenes.

Si bien la mayoría de las personas usa Stable Diffusion con indicaciones de texto, Bühlmann cortó el codificador de texto y, en su lugar, forzó sus imágenes a través del proceso de codificador de imágenes de Stable Diffusion, que toma una imagen de 512 × 512 de baja precisión y la convierte en una imagen latente de 64 × 64 de mayor precisión. representación espacial. En este punto, la imagen existe en un tamaño de datos mucho más pequeño que el original, pero aún se puede expandir (decodificar) nuevamente a una imagen de 512 × 512 con resultados bastante buenos.

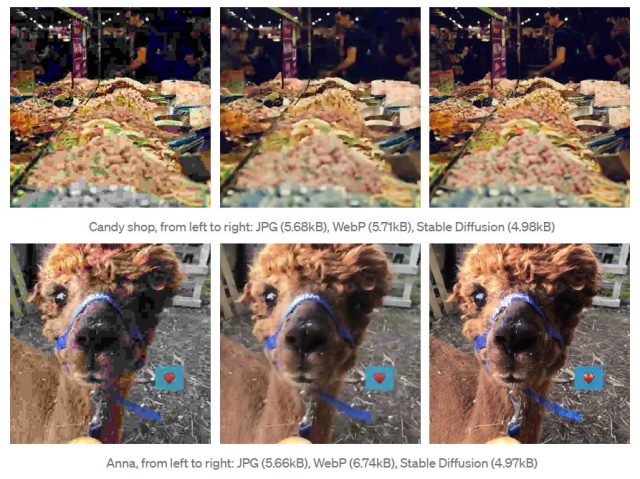

Mientras realizaba pruebas, Bühlmann descubrió que las imágenes comprimidas con Stable Diffusion se veían subjetivamente mejor con relaciones de compresión más altas (tamaño de archivo más pequeño) que JPEG o WebP. En un ejemplo, muestra una foto de una tienda de golosinas comprimida a 5,68 KB con JPEG, 5,71 KB con WebP y 4,98 KB con Stable Diffusion. La imagen de difusión estable parece tener más detalles resueltos y menos artefactos de compresión evidentes que las comprimidas en los otros formatos.

Sin embargo, el método de Bühlmann actualmente tiene limitaciones significativas: no es bueno con caras o texto y, en algunos casos, puede alucinar características detalladas en la imagen decodificada que no estaban presentes en la imagen de origen. (Probablemente no desee que su compresor de imágenes invente detalles en una imagen que no existe). Además, la decodificación requiere el archivo de pesos de difusión estable de 4 GB y tiempo adicional de decodificación.

Si bien este uso de Stable Diffusion no es convencional y es más un truco divertido que una solución práctica, podría apuntar potencialmente a un novedoso uso futuro de los modelos de síntesis de imágenes. El código de Bühlmann puede ser encontrado en Google Colab, y encontrará más detalles técnicos sobre su experimento en su publicar en Hacia la IA.