El ingeniero de Facebook estaba ansioso por saber por qué su cita no había respondido a sus mensajes. Quizás había una explicación simple: quizás estaba enferma o de vacaciones.

Entonces, a las 10 pm una noche en la sede de la compañía en Menlo Park, él abrió su perfil de Facebook en los sistemas internos de la compañía y comenzó a buscar sus datos personales. Su política, su estilo de vida, sus intereses, incluso su ubicación en tiempo real.

El ingeniero sería despedido por su comportamiento, junto con otros 51 empleados que habían abusado de manera inapropiada de su acceso a los datos de la empresa, un privilegio que estaba disponible para todos los que trabajaban en Facebook, independientemente de su función laboral o antigüedad. La gran mayoría de los 51 eran como él: hombres que buscaban información sobre las mujeres que les interesaban.

En septiembre de 2015, después de que Alex Stamos, el nuevo director de seguridad, señalara el problema a la atención de Mark Zuckerberg, el director ejecutivo ordenó una revisión del sistema para restringir el acceso de los empleados a los datos de los usuarios. Fue una victoria poco común para Stamos, una en la que convenció a Zuckerberg de que el diseño de Facebook era el culpable, más que el comportamiento individual.

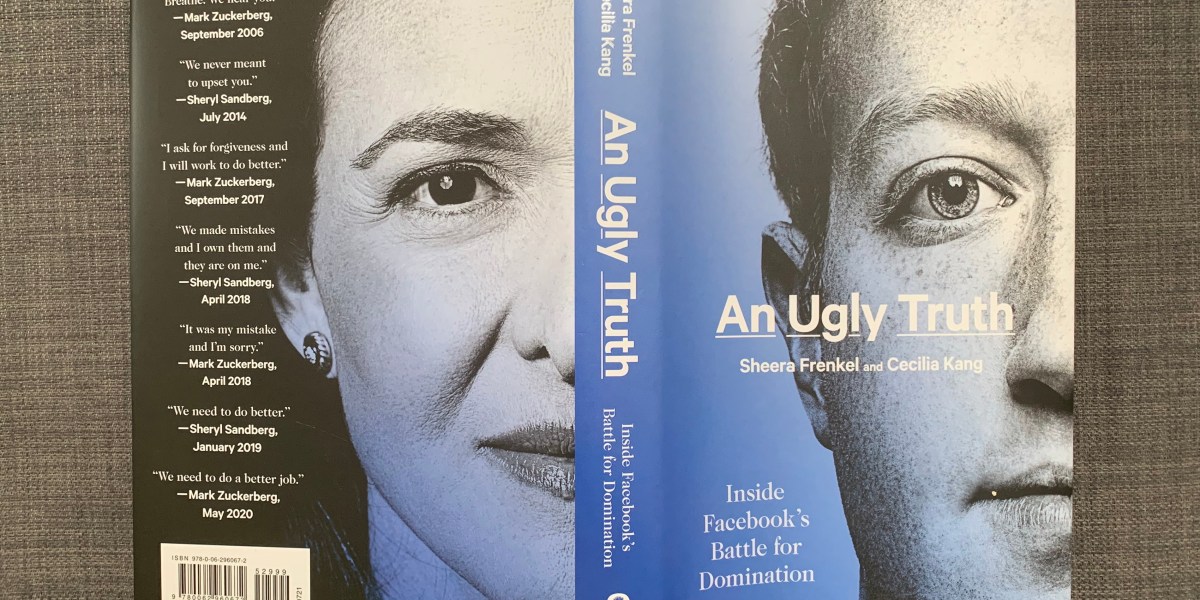

Así comienza Una fea verdad, un nuevo libro sobre Facebook escrito por los veteranos reporteros del New York Times Sheera Frenkel y Cecilia Kang. Con la experiencia de Frenkel en ciberseguridad, la experiencia de Kang en tecnología y políticas regulatorias, y su gran cantidad de fuentes, el dúo proporciona un relato convincente de los años de Facebook que abarcan las elecciones de 2016 y 2020.

Stamos ya no tendría tanta suerte. Los problemas que se derivaron del modelo comercial de Facebook solo se intensificarían en los años siguientes, pero a medida que Stamos descubrió problemas más atroces, incluida la interferencia rusa en las elecciones estadounidenses, fue expulsado por hacer que Zuckerberg y Sheryl Sandberg enfrentaran verdades inconvenientes. Una vez que se fue, el liderazgo continuó negándose a abordar toda una serie de problemas profundamente inquietantes, incluido el escándalo de Cambridge Analytica, el genocidio en Myanmar y la desinformación desenfrenada de los cómplices.

BEOWULF SHEEHAN

Frenkel y Kang argumentan que los problemas de Facebook en la actualidad no son producto de una empresa que perdió el rumbo. En cambio, son parte de su propio diseño, construido sobre la estrecha visión del mundo de Zuckerberg, la cultura de privacidad descuidada que cultivó y las asombrosas ambiciones que persiguió con Sandberg.

Cuando la empresa era todavía pequeña, tal vez se pudiera excusar tal falta de previsión e imaginación. Pero desde entonces, las decisiones de Zuckerberg y Sandberg han demostrado que el crecimiento y los ingresos superan a todo lo demás.

En un capítulo titulado “Compañía sobre el país”, por ejemplo, los autores relatan cómo el liderazgo trató de enterrar el alcance de la interferencia electoral rusa en la plataforma por parte de la comunidad de inteligencia estadounidense, el Congreso y el público estadounidense. Censuraron los múltiples intentos del equipo de seguridad de Facebook de publicar detalles de lo que habían encontrado y seleccionaron los datos para restar importancia a la gravedad y la naturaleza partidista del problema. Cuando Stamos propuso un rediseño de la organización de la empresa para evitar que se repita el problema, otros líderes descartaron la idea como “alarmista” y centraron sus recursos en controlar la narrativa pública y mantener a raya a los reguladores.