Recientemente Facebook, Reddit, Google, LinkedIn, Microsoft, Twitter y YouTube comprometido a eliminar información errónea relacionada con el coronavirus de sus plataformas.

COVID-19 se describe como La primera gran pandemia de la era de las redes sociales. En tiempos difíciles, las redes sociales ayudan a distribuir conocimiento vital a las masas. Desafortunadamente, esto viene con una miríada de información errónea, gran parte de la cual se propaga a través de los bots de redes sociales.

Estas cuentas falsas son comunes en Twitter, Facebook e Instagram. Tienen un objetivo: difundir miedo y noticias falsas.

Hemos sido testigos de esto en el Elecciones presidenciales de Estados Unidos de 2016, con rumores de incendios provocados en la crisis de incendios forestales, y lo estamos viendo nuevamente en relación con la pandemia de coronavirus.

Ocupado revienta bots

La escala exacta de información errónea es difícil de medir. Pero su presencia global se puede sentir a través de instantáneas de la participación de bot de Twitter en la actividad de hashtag relacionada con COVID-19.

Bot Sentinel es un sitio web que utiliza el aprendizaje automático para identificar posibles bots de Twitter, utilizando una puntuación y calificación. Según el sitio, el 26 de marzo

Estos hashtags, respectivamente, ocuparon la 1ª, 3ª y 7ª posición de todos los hashtags de Twitter más controlados.

Es importante tener en cuenta que el número real de tweets de bot relacionados con el coronavirus es probablemente mucho mayor, ya que Bot Sentinel solo reconoce los términos hashtag (como #coronavirus), y no se da cuenta de "coronavirus", "COVID19" o "Coronavirus" .

¿Cómo se crean los bots?

Los bots generalmente son administrados por programas automatizados llamados "campañas" de bots, y estos son controlados por usuarios humanos.

El proceso real de crear una campaña de este tipo es relativamente simple. Hay varios sitios web que enseñan a las personas cómo hacer esto con fines de "marketing". En la economía hacker subterránea en la web oscura, dichos servicios están disponibles para contratar.

Si bien es difícil atribuir bots a los humanos que los controlan, el propósito de las campañas de bot es obvio: crear desorden social al difundir información errónea. Esto puede aumentar la ansiedad pública, la frustración y la ira contra las autoridades en ciertas situaciones.

Un informe de 2019 publicado por investigadores del Oxford Internet Institute reveló una tendencia preocupante en la "manipulación de redes sociales organizada por gobiernos y partidos políticos". Ellos informaron:

Evidencia de campañas organizadas de manipulación de redes sociales que han tenido lugar en 70 países, frente a 48 países en 2018 y 28 países en 2017. En cada país, hay al menos un partido político o agencia gubernamental que usa las redes sociales para moldear las actitudes públicas a nivel nacional.

El modus operandi de los bots

Típicamente, en el contexto de los mensajes COVID-19, los bots difundirían información errónea a través de dos técnicas principales.

El primero implica la creación de contenido, en el que los bots comienzan nuevas publicaciones con imágenes que validan o reflejan las tendencias mundiales existentes. Los ejemplos incluyen fotos de cestas de compras llenas de comida, o acumuladores que vacían los estantes de los supermercados. Esto genera ansiedad y confirma lo que las personas leen de otras fuentes.

La segunda técnica implica el aumento de contenido. En esto, los bots se conectan a los sitios oficiales de noticias y noticias del gobierno para sembrar la discordia. Retuitean tweets alarmantes o agregan comentarios e información falsos en un intento por avivar el miedo y la ira entre los usuarios. Es común ver a los bots hablando de un "evento frustrante" o alguna injusticia social que enfrentan sus "seres queridos".

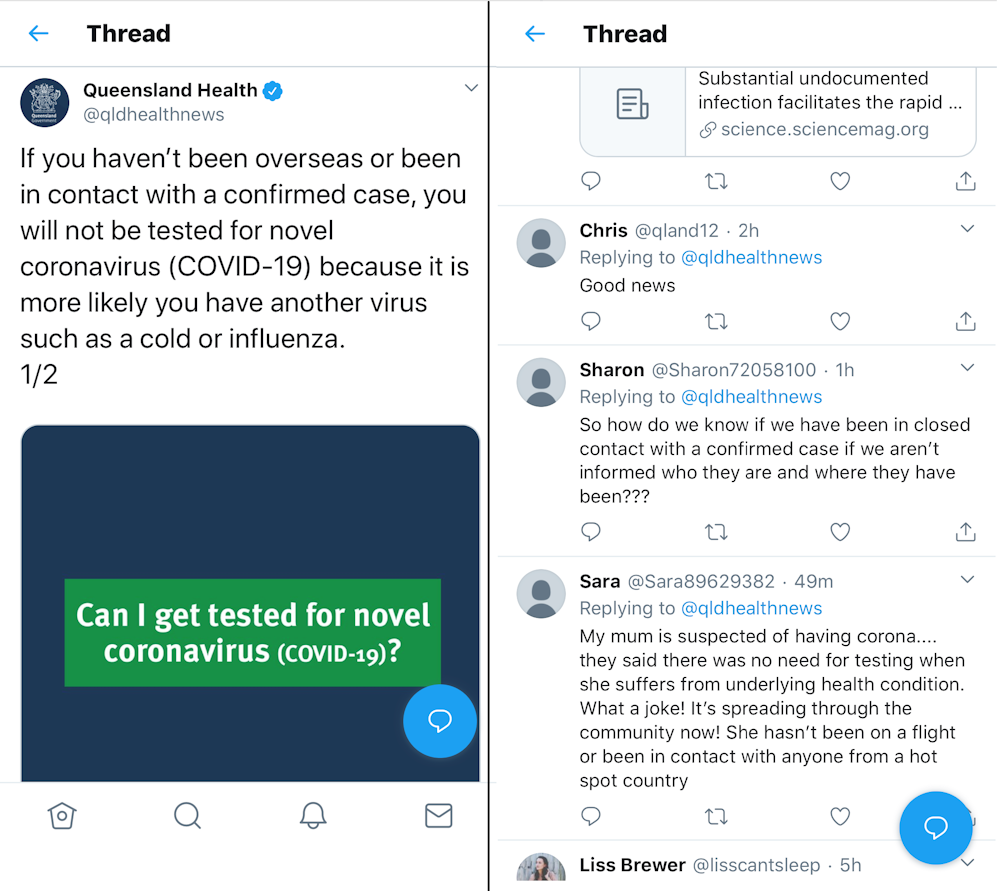

El siguiente ejemplo muestra una publicación en Twitter de la página oficial de Twitter de Queensland Health, seguida de comentarios de cuentas llamadas "Sharon" y "Sara" que he identificado como cuentas de bot. Muchos usuarios reales que leen la publicación de Sara indudablemente sentirían una sensación de injusticia en nombre de su "madre".

Si bien no podemos estar 100 por ciento seguros de que se trata de cuentas de bot, muchos factores apuntan a que es muy probable que sea así. Nuestra capacidad para identificar con precisión los bots mejorará a medida que mejoren los algoritmos de aprendizaje automático en programas como Bot Sentinel.

Cómo detectar un bot

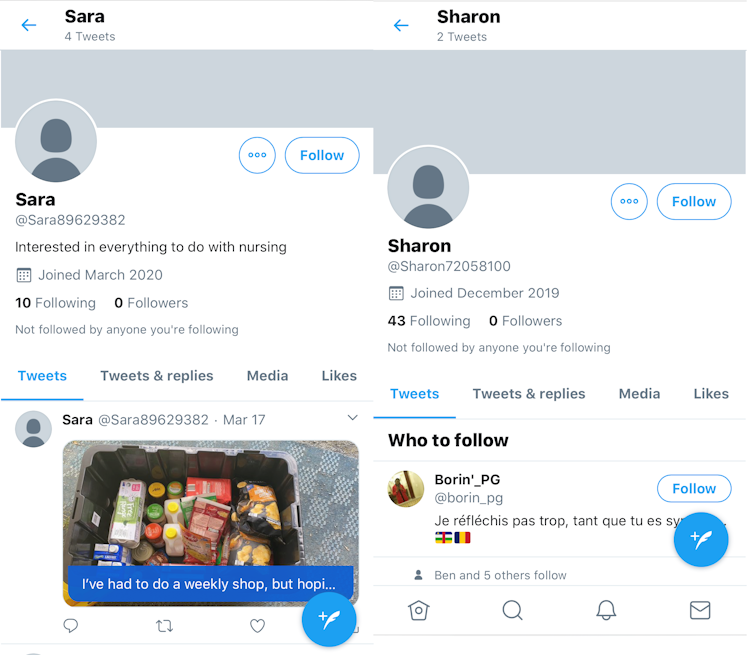

Para conocer las características de un bot, echemos un vistazo más de cerca a las cuentas de Sharon y Sara.

Ambos perfiles carecen de singularidad humana y muestran algunos signos reveladores de que pueden ser bots:

-

no tienen seguidores

-

solo se unieron recientemente a Twitter

-

no tienen apellidos y tienen identificadores alfanuméricos (como Sara89629382)

-

solo han twitteado unas pocas veces

-

sus publicaciones tienen un tema: difundir comentarios alarmistas

- en su mayoría siguen sitios de noticias, autoridades gubernamentales o usuarios humanos que tienen una gran influencia en un determinado tema (en este caso, virología y medicina).

Mi investigación sobre Sharon reveló que el bot había intentado exacerbar la ira en un artículo de noticias sobre la respuesta del coronavirus del gobierno federal.

El idioma: "La salud no puede esperar. La economía (sic) puede" indica un hablante de inglés potencialmente no nativo.

Parece que Sharon estaba tratando de avivar las llamas de la ira pública al llamar "malas decisiones".

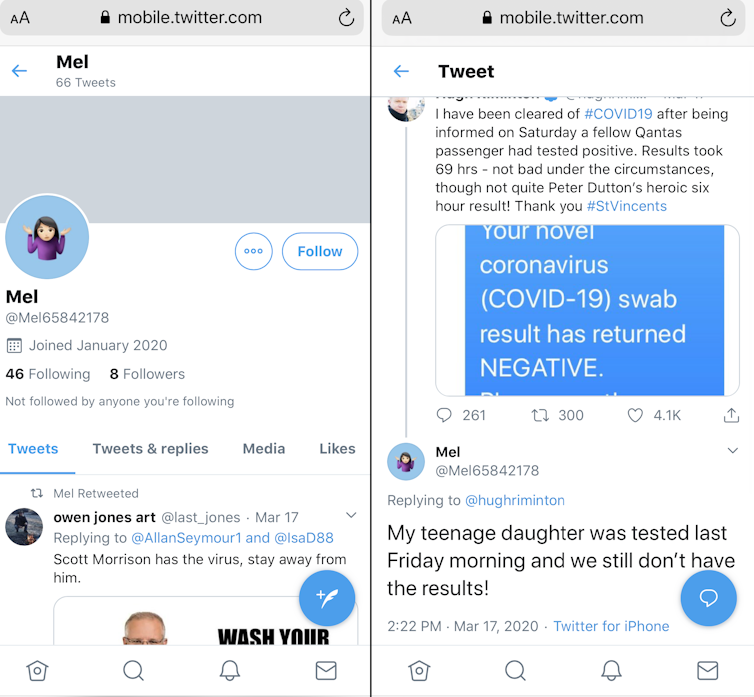

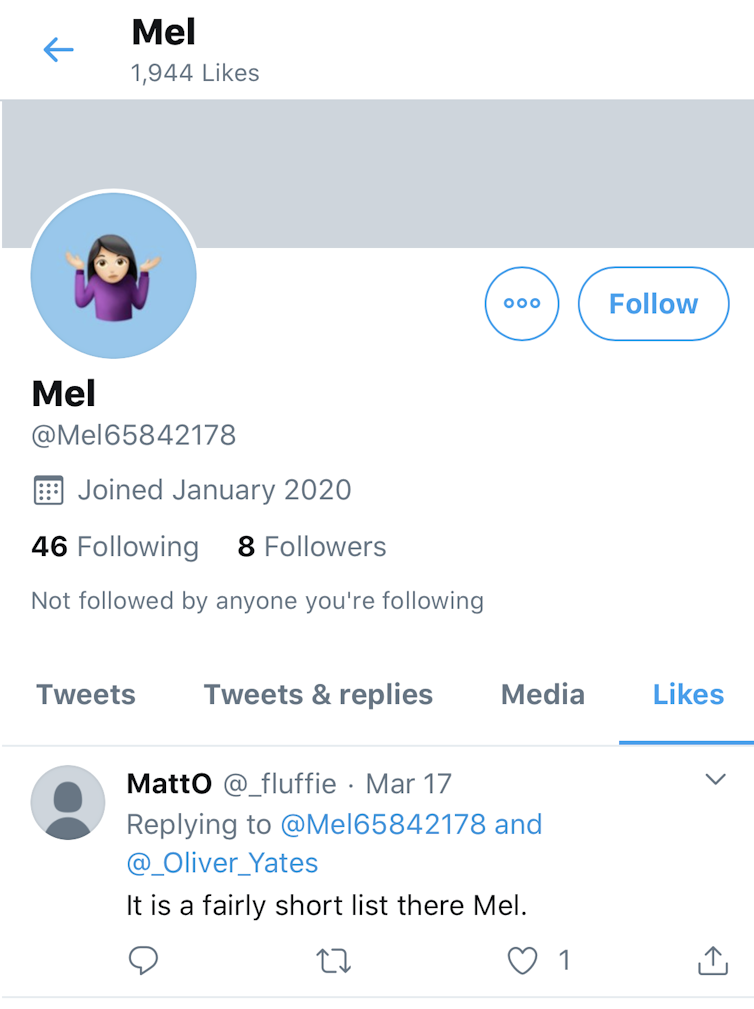

Al revisar los tweets de Sharon, descubrí al amigo de Sharon "Mel", otro bot con su propia agenda programada.

Lo preocupante era que un usuario humano estaba interactuando con Mel.

Puedes ayudar a abordar la información errónea

Actualmente, es simplemente demasiado difícil atribuir la verdadera fuente de campañas de desinformación impulsadas por bots. Esto solo se puede lograr con la plena cooperación de las empresas de redes sociales.

Los motivos de una campaña bot pueden ir desde la creación de travesuras hasta el ejercicio del control geopolítico. Y algunos investigadores aún no pueden ponerse de acuerdo sobre qué constituye exactamente un "bot".

Pero una cosa es segura: Australia necesita desarrollar legislación y mecanismos para detectar y detener a estos culpables automatizados. Las organizaciones que ejecutan campañas legítimas en las redes sociales deberían dedicar tiempo a utilizar un herramienta de detección de bot para eliminar e informar cuentas falsas.

Y como usuario de las redes sociales en la era del coronavirus, también puede ayudar reportando cuentas sospechosas. Lo último que necesitamos son partes maliciosas que empeoren una crisis ya preocupante.

Ryan Ko, Profesor Presidente y Director de Seguridad Cibernética, La universidad de Queensland.

Este artículo se republica de La conversación bajo una licencia Creative Commons. Leer el artículo original.