Ha sido casi un año desde el surgimiento de las plataformas de “AI art” (tampoco es verdaderamente “IA” o el arte), y en ese tiempo los artistas han tuvo que sentarse y mirar con impotencia cómo sus trabajos creativos han sido absorbidos por aprendizaje automático y se utiliza para crear nuevas imágenes sin crédito ni compensación.

Ahora, sin embargo, un equipo de investigadores de la Universidad de Chicago, que trabaja con artistas, algunos de los cuales aparecieron en mi historia del año pasado, ha ideado algo que se espera permita a los artistas tomar medidas activas para proteger su trabajo.

Se llama Glaze y funciona agregando una segunda capa, casi invisible, encima de una obra de arte. Lo que hace que todo sea tan interesante es que no se trata de una capa hecha de ruido o de formas aleatorias. También contiene una obra de arte, una que es más o menos de la misma composición, pero en un totalmente

Glaze se enfoca específicamente en la forma en que estas plataformas de aprendizaje automático han podido permitir a sus usuarios “proponer” imágenes que se basan específicamente en el estilo de un artista humano. Entonces alguien puede pedir una ilustración al estilo de Ralph McQuarrie, y debido a que esas plataformas han podido levantar suficiente trabajo de McQuarrie para saber cómo copiarlo, obtendrán algo que se parece más o menos al trabajo de Ralph McQuarrie.

Al cubrir una obra de arte con otro obra de arte, sin embargo, Glaze está lanzando estas plataformas fuera de lugar. Tomando como ejemplo a la artista Karla Ortiz, explican:

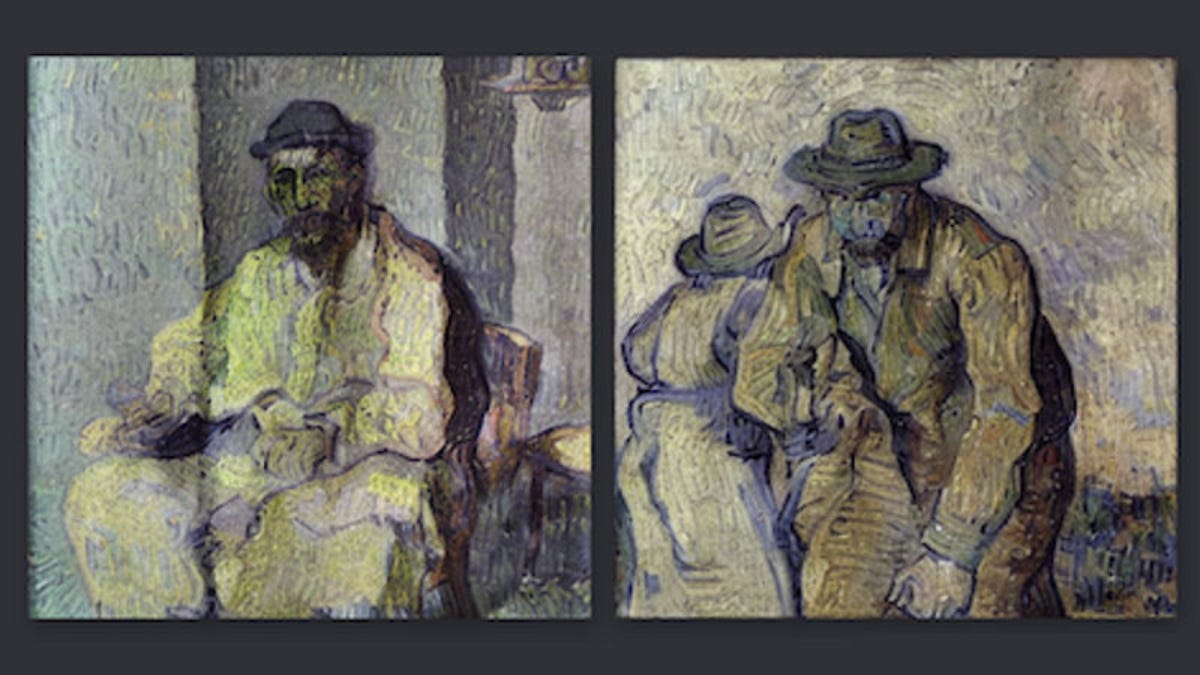

Stable Diffusion hoy puede aprender a crear imágenes al estilo de Karla después de ver algunas piezas de la obra de arte original de Karla (tomadas del portafolio en línea de Karla). Sin embargo, si Karla usa nuestra herramienta para encubrir su obra de arte, agregando pequeños cambios antes de publicarlos en su carpeta en línea, Stable Diffusion no aprenderá el estilo artístico de Karla. En cambio, la modelo interpretará su arte como un estilo diferente (por ejemplo, el de Vincent van Gogh). Alguien que incitara a Stable Diffusion a generar “obras de arte al estilo de Karla Ortiz” obtendría imágenes al estilo de Van Gogh (o algún híbrido). Esto protege el estilo de Karla de ser reproducido sin su consentimiento.

¡Limpio! Por supuesto, esto no hace nada por los incontables miles de millones de imágenes que ya han sido levantadas por estas plataformas, pero al menos a corto plazo, esto finalmente les dará a los artistas algo que pueden usar para proteger activamente cualquier trabajo nuevo que publiquen en línea. Sin embargo, nadie sabe cuánto dura ese corto plazo, ya que el equipo de Glaze admite que “no es una solución permanente contra el mimetismo de la IA”, ya que “la IA evoluciona rápidamente y los sistemas como Glaze enfrentan el desafío inherente de estar preparados para el futuro”.

Si quieres probar Glaze, Puedes descargarlo aquídonde también se puede leer el trabajo académico completo del equipo.