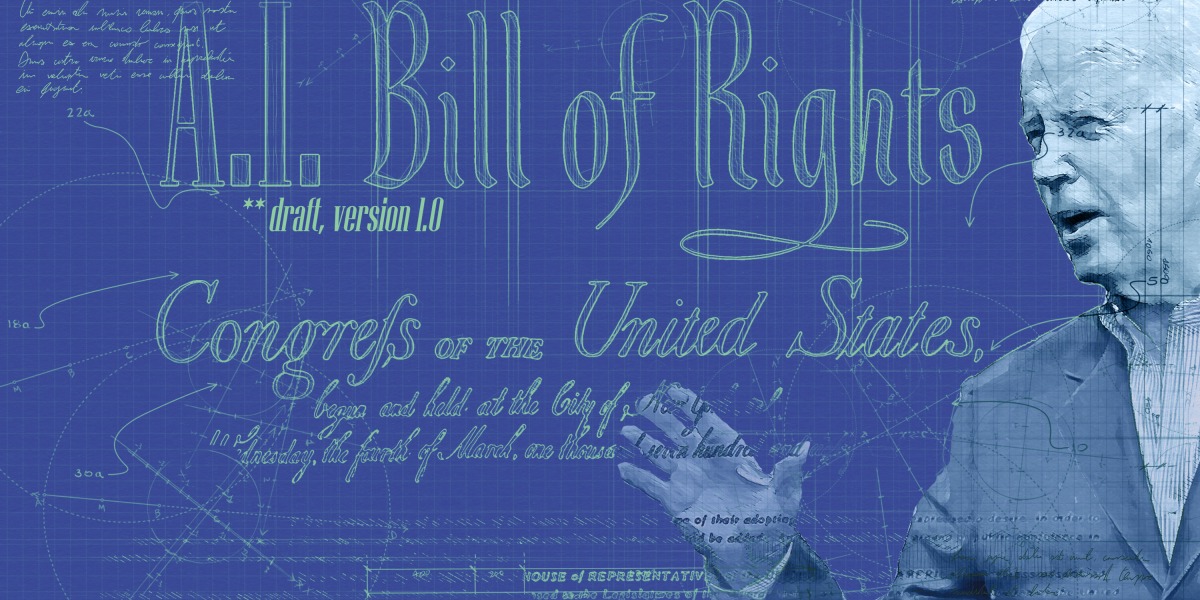

Ya era hora. Esa fue la respuesta de expertos en política y ética de IA a la noticia la semana pasada de que la Oficina de Política Científica y Tecnológica, la agencia asesora de ciencia y tecnología de la Casa Blanca, había presentado una Declaración de Derechos de IA. El documento es la visión de Biden de cómo el gobierno de EE. UU., las empresas de tecnología y los ciudadanos deben trabajar juntos para responsabilizar al sector de la IA.

Es una gran iniciativa, y desde hace mucho tiempo. Hasta ahora, EE. UU. ha sido una de las únicas naciones occidentales sin una guía clara sobre cómo proteger a sus ciudadanos contra los daños de la IA. (Como recordatorio, estos daños incluyen arrestos injustificados, suicidios

Las empresas tecnológicas dicen que quieren mitigar este tipo de daños, pero es realmente difícil pedirles cuentas.

La Declaración de derechos de la IA describe cinco protecciones que los estadounidenses deben tener en la era de la IA, incluida la privacidad de los datos, el derecho a estar protegido de sistemas inseguros y garantías de que los algoritmos no deben ser discriminatorios y que siempre habrá una alternativa humana. Lea más sobre esto aquí.

Así que aquí están las buenas noticias: La Casa Blanca ha demostrado un pensamiento maduro sobre los diferentes tipos de daños de la IA, y esto debería filtrarse a cómo piensa el gobierno federal sobre los riesgos tecnológicos de manera más amplia. La UE está presionando con regulaciones que intentan mitigar ambiciosamente todos los daños de la IA. Eso es genial, pero increíblemente difícil de hacer, y podrían pasar años antes de que su ley de IA, llamada Ley de IA, esté lista. EE. UU., por otro lado, “puede abordar un problema a la vez”, y las agencias individuales pueden aprender a manejar los desafíos de la IA a medida que surgen, dice Alex Engler, quien investiga la gobernanza de la IA en Brookings Institution, un grupo de expertos de DC.

Y lo malo: A la Declaración de Derechos de AI le faltan algunas áreas de daño bastante importantes, como la aplicación de la ley y la vigilancia de los trabajadores. Y a diferencia de la actual Declaración de Derechos de EE. UU., la Declaración de Derechos de AI es más una recomendación entusiasta que una ley vinculante. “Francamente, los principios no son suficientes”, dice Courtney Radsch, experta en políticas tecnológicas de EE. UU. para la organización de derechos humanos Article 19. ” ella agrega.

Estados Unidos camina sobre la cuerda floja. Por un lado, Estados Unidos no quiere parecer débil en el escenario mundial cuando se trata de este tema. EE. UU. desempeña quizás el papel más importante en la mitigación de los daños causados por la IA, ya que la mayoría de las empresas de IA más grandes y ricas del mundo son estadounidenses. Pero ese es el problema. A nivel mundial, EE. UU. tiene que cabildear contra las reglas que establecerían límites para sus gigantes tecnológicos, y a nivel nacional se resiste a introducir cualquier regulación que pueda “obstaculizar la innovación”.

Los próximos dos años serán críticos para la política global de IA. Si los demócratas no ganan un segundo mandato en las elecciones presidenciales de 2024, es muy posible que se abandonen estos esfuerzos. Nuevas personas con nuevas prioridades podrían cambiar drásticamente el progreso realizado hasta ahora o llevar las cosas en una dirección completamente diferente. Nada es imposible.