La era de la mala música de robots está sobre nosotros. Adobe está trabajando en una nueva herramienta de inteligencia artificial que permitirá a cualquiera ser productor musical, sin necesidad de instrumentos ni experiencia en edición.

La empresa dio a conocer “Control GenAI de Proyecto Música”—un nombre muy largo—esta semana. La herramienta permite a los usuarios crear y editar música simplemente escribiendo mensajes de texto en un modelo de IA generativo. Estos pueden incluir descripciones como “rock po deroso”, “baile feliz” o “jazz triste”, explicó Adobe.

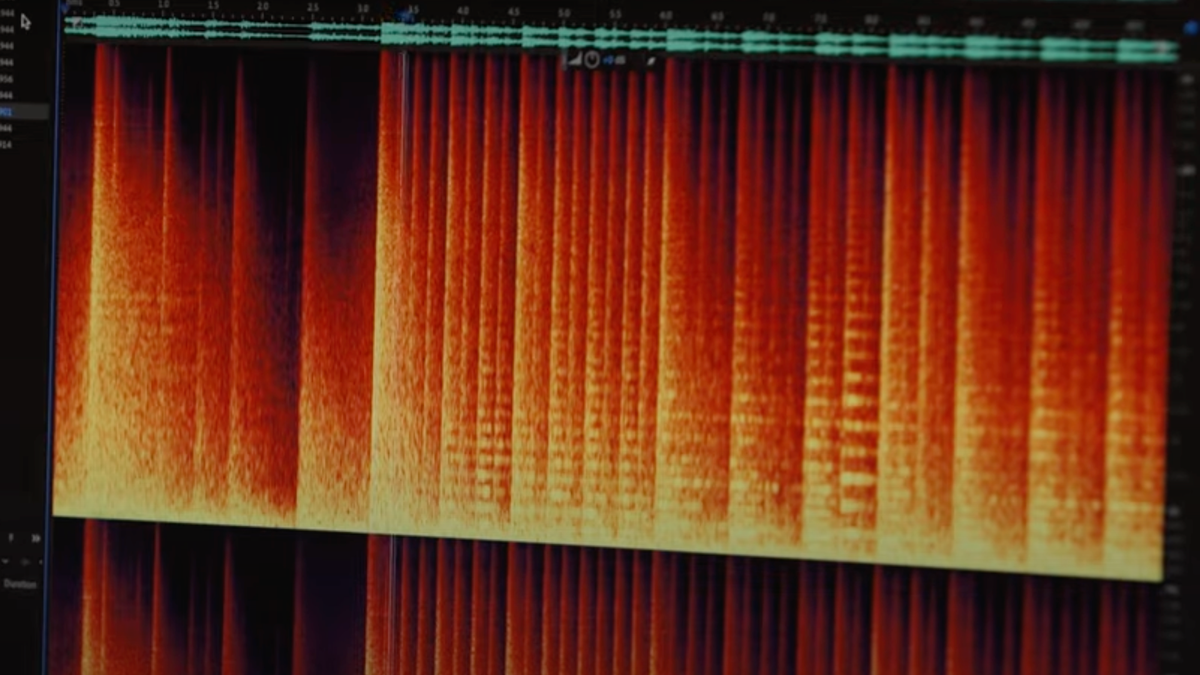

Project Music GenAI Control luego creará una melodía inicial basada en la indicación del usuario, que también podrá editar usando texto. Adobe dijo que los usuarios pueden, por ejemplo, editar la intensidad de la música generada, extender la duración del clip musical o crear un bucle repetible, entre otras cosas.

El público objetivo de esta nueva herramienta incluye podcasters, locutores y “cualquier otra persona que necesite audio con el estado de ánimo, tono y duración adecuados”, dijo Nicholas Bryan, científico investigador senior de Adobe y uno de los creadores de la tecnología.

“Una de las cosas interesantes de estas nuevas herramientas es que no sirven sólo para generar audio: lo llevan al nivel de Photoshop al brindar a los creativos el mismo tipo de control profundo para dar forma, ajustar y editar su audio. “Bryan afirmó en un blog de adobe. “Es una especie de control de nivel de píxeles para la música”.

Adobe subió un vídeo que mostraba cómo funcionaba Project Music GenAI Control y daba miedo lo fácil que era para la herramienta crear música. También pareció funcionar muy rápido. Si bien la música que generó no ganará ningún Grammy, es algo que definitivamente puedo imaginar escuchar en el fondo de videos de YouTube, TikToks o transmisiones de Twitch.

Eso no es exactamente algo bueno. La IA ha repercutido en profesiones como la escritura y la actuación, obligando a los trabajadores a tomar una posición y evitar que les roben sus medios de vida. Los comentarios en el vídeo de YouTube de la empresa se hicieron eco de estas preocupaciones y criticaron a la empresa por crear “música escrita por robots, para robots” y “buena vergüenza corporativa”.

“Gracias a Adobe por intentar encontrar aún más formas para que las corporaciones dejen a los creativos sin trabajo. Además, ¿de qué artistas robaste el material que usaste para entrenar tu IA? escribió un usuario.

Cuando Gizmodo le pidió comentarios, Adobe no reveló detalles sobre la música utilizada para entrenar su modelo de IA para Project Music GenAI Control. Sin embargo, sí señaló que con Firefly, su familia de generadores de imágenes de IA, solo había entrenado sus modelos en dominios de dominio público y con licencia abierta donde los derechos de autor habían expirado.

“El control Project Music GenAI es una mirada muy temprana a la tecnología desarrollada por Adobe Research y, aunque todavía no revelamos los detalles del modelo, lo que podemos compartir es: Adobe siempre ha adoptado un enfoque proactivo para garantizar que estemos innovando de manera responsable. ”, dijo a Gizmodo Anais Gragueb, portavoz de Adobe, en un correo electrónico.

La música es arte e inherentemente humana. Como tal, debemos tener cuidado cuando se trata de nuevas herramientas como la de Adobe, o arriesgarnos a un futuro en el que la música suene tan vacía como las máquinas que la generan.

Actualización 1/03/2024, 5:56 pm ET: Esta publicación se actualizó con comentarios adicionales de Adobe.